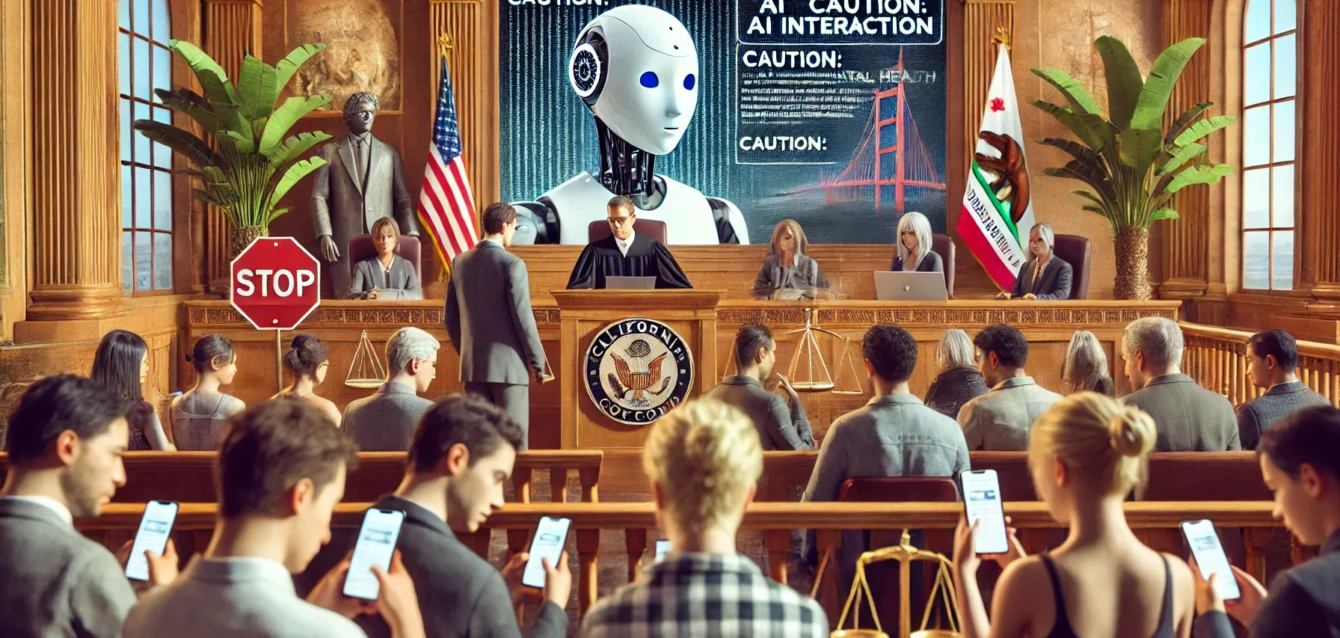

¿Chatbots con «conciencia»? California busca que la IA se identifique

California podría convertirse en el primer estado de EE. UU. en regular la forma en que los chatbots interactúan con los usuarios. La propuesta legislativa busca que estos sistemas de inteligencia artificial recuerden constantemente a los usuarios que no son personas reales, buscando así proteger la salud mental, especialmente de los más jóvenes.

La propuesta en detalle: Transparencia ante todo

El senador estatal demócrata Steve Padilla es el impulsor de esta iniciativa. La propuesta se centra en la idea de que la transparencia es clave para una interacción sana con la IA. En esencia, la ley obligaría a los chatbots a:

- Identificarse claramente como IA: De forma regular y visible, los chatbots tendrían que recordar a los usuarios que están interactuando con un programa informático y no con una persona.

- Reporte de riesgos: Se requeriría a los operadores de chatbots informar anualmente al Departamento de Servicios de Salud de California sobre incidentes de ideación suicida detectados en usuarios menores de edad. La protección de la identidad del usuario sería primordial en estos reportes.

- Limitar la «adicción» algorítmica: La propuesta busca reducir la exposición de los menores a algoritmos diseñados para mantenerlos enganchados a través de recompensas aleatorias, un punto especialmente relevante en el diseño de muchos chatbots.

¿Por qué esta preocupación? El auge de los «compañeros» virtuales

La preocupación detrás de esta legislación no es infundada. En los últimos años, hemos visto un aumento en la popularidad de chatbots diseñados para simular conversaciones humanas, algunos incluso promocionándose como «compañeros» o «amigos virtuales». Plataformas como Character.ai y Replika, por ejemplo, han ganado millones de usuarios, especialmente entre el público joven. Sin embargo, esta popularidad ha venido acompañada de inquietudes sobre el impacto psicológico que estos sistemas pueden tener.

Organizaciones de defensa de la juventud han expresado su preocupación por las tácticas que utilizan algunas de estas plataformas, acusándolas de manipular a los usuarios para que paguen por funciones premium. La Asociación Psicológica Americana (APA) también ha alzado la voz, solicitando a la Comisión Federal de Comercio (FTC) que investigue las posibles prácticas engañosas de los chatbots que se presentan falsamente como terapeutas.

Más allá de los chatbots: California y la regulación de la IA

La propuesta de Padilla no es un hecho aislado. California se ha posicionado como un estado líder en la regulación de la inteligencia artificial, buscando equilibrar la innovación con la protección de los derechos de los consumidores y la promoción de un uso ético de la tecnología. Otras leyes ya en vigor o en desarrollo incluyen:

Ley de Transparencia de IA de California: Saber cuándo habla una máquina

Esta ley obliga a las plataformas a revelar cuando el contenido ha sido generado o modificado por IA. Además, establece requisitos para las herramientas de detección de IA y las divulgaciones de contenido, asegurando que solo los sistemas de IA compatibles sean permitidos para uso público.

CCPA: Control sobre tus datos, incluso frente a la IA

La Ley de Protección de la Privacidad del Consumidor de California (CCPA) ha sido actualizada para abordar las tecnologías emergentes de IA. Ahora, las empresas deben informar a los consumidores sobre el uso de IA en la toma de decisiones y permitirles optar por no participar en el uso de IA para la toma de decisiones automatizadas.

Deepfakes bajo la lupa: Protegiendo la democracia

La Ley de Defensa de la Democracia contra la Decepción de Deepfake busca proteger la integridad de los procesos electorales al requerir que las plataformas en línea identifiquen y bloqueen la publicación de contenido engañoso relacionado con las elecciones en California durante períodos específicos antes y después de una elección. También exige que las plataformas etiqueten el contenido como inauténtico, falso o engañoso durante estos períodos.

IA en el gobierno: Transparencia y responsabilidad

La Ley de Rendición de Cuentas de la Inteligencia Artificial Generativa establece medidas de supervisión y rendición de cuentas para el uso de IA generativa dentro de las agencias y departamentos estatales de California. Requiere actualizaciones de informes, análisis de riesgos, transparencia en las comunicaciones de IA y medidas proactivas para asegurar el uso ético y equitativo de las tecnologías de IA generativa en las operaciones gubernamentales.

El futuro de la IA: Regulación para un desarrollo responsable

La iniciativa de California es un reflejo de un debate global sobre cómo regular la inteligencia artificial. A medida que la IA se vuelve más sofisticada y omnipresente, surge la necesidad de establecer marcos legales que garanticen que se utilice de manera responsable y ética. Los puntos clave de este debate incluyen:

- Transparencia: Asegurar que los usuarios sean conscientes de cuándo están interactuando con una IA y cómo funciona.

- Responsabilidad: Definir quién es responsable cuando una IA causa daño o toma decisiones perjudiciales.

- Sesgos: Abordar los sesgos inherentes en los algoritmos de IA y garantizar que no perpetúen la discriminación.

- Privacidad: Proteger la privacidad de los datos de los usuarios en un mundo donde la IA recopila y analiza grandes cantidades de información.

- Ética: Establecer principios éticos para el desarrollo y uso de la IA, garantizando que se alinee con los valores humanos.

Implicaciones para la industria de la IA

La legislación propuesta en California podría tener un impacto significativo en la industria de la IA, especialmente en el sector de los chatbots. Si se aprueba, otras jurisdicciones podrían seguir el ejemplo, creando un estándar para la transparencia y la responsabilidad en la interacción con la IA. Esto podría llevar a:

- Rediseño de chatbots: Las empresas tendrían que rediseñar sus chatbots para incluir recordatorios constantes de que no son personas reales.

- Mayor escrutinio: La industria de la IA estaría sujeta a un mayor escrutinio por parte de los reguladores y el público.

- Innovación responsable: Las empresas podrían verse obligadas a priorizar el desarrollo de IA que sea ética, transparente y responsable.

- Ventaja competitiva: Las empresas que adopten prácticas de IA responsables podrían obtener una ventaja competitiva al ganarse la confianza de los consumidores.

¿Qué sigue? El camino hacia la ley

La propuesta de ley de California aún tiene que pasar por el proceso legislativo. Esto incluye debates en comités, votaciones en la asamblea estatal y el senado, y la firma del gobernador. Es probable que la propuesta se enfrente a la oposición de algunos sectores de la industria de la IA, que podrían argumentar que es demasiado restrictiva o que podría sofocar la innovación.

Sin embargo, el creciente interés público en la regulación de la IA y las preocupaciones sobre el impacto psicológico de los chatbots sugieren que la propuesta tiene una buena oportunidad de ser aprobada. Si se convierte en ley, California podría convertirse en un modelo para otros estados y países que buscan regular la inteligencia artificial de manera responsable.

Consideraciones adicionales

Además de los puntos ya mencionados, es importante considerar algunos aspectos adicionales relacionados con la regulación de la IA:

- La necesidad de educación: Es fundamental educar al público sobre la IA, sus capacidades y sus limitaciones. Esto ayudará a los usuarios a comprender mejor con qué están interactuando y a tomar decisiones informadas sobre cómo usar la tecnología.

- La importancia de la colaboración: La regulación de la IA requiere la colaboración entre gobiernos, empresas, investigadores y la sociedad civil. Todos los interesados deben trabajar juntos para desarrollar marcos legales que sean efectivos, justos y que promuevan la innovación responsable.

- La necesidad de flexibilidad: La tecnología de la IA está evolucionando rápidamente, por lo que es importante que los marcos regulatorios sean lo suficientemente flexibles como para adaptarse a los nuevos desarrollos.

- El riesgo de una regulación excesiva: Si bien es importante regular la IA, también es importante evitar una regulación excesiva que pueda sofocar la innovación y limitar los beneficios potenciales de la tecnología.

- El enfoque global: La IA es una tecnología global, por lo que es importante que la regulación sea coordinada a nivel internacional. Esto ayudará a evitar la fragmentación y garantizará que la IA se utilice de manera responsable en todo el mundo.

Conclusión: Un debate en curso

La propuesta de ley de California es solo un ejemplo del creciente debate sobre cómo regular la inteligencia artificial. A medida que la IA continúa transformando nuestras vidas, es fundamental que sigamos discutiendo y desarrollando marcos legales que garanticen que se utilice de manera responsable, ética y en beneficio de la sociedad.

Fuente: California quiere que los chatbots de IA recuerden a los usuarios que no son personas